La eterna pugna entre dos tipos duros: Arial y Helvética

Helvética/Arial

Helvética es una familia tipográfica diseñada en 1957 por Max Miedinger, un afamado tipógrafo suizo, para la fundición experta en esta lides conocida como Haas (por supuesto, hablamos de cuando los tipos eran piezas metálicas de imprenta con los caracteres en realce). Su desarrollo se basó en una tipografía anterior denominada Akzidenz Grotesk, datada en 1896.

Más tarde, Haas se unió con Linotype, una empresa norteamericana formada para comercializar la máquina Linotipia y que se convirtió en la mayor compañía de equipamiento para impresión de libros y periódicos del mundo. En esta unión se promovió el uso de la Helvética fuertemente, y durante la segunda parte de siglo XX fue uno de los tipos más populares en el mundo occidental.

Helvética fue acuñada como un tipo de estilo sencillo y de palo seco, es decir, sin remates, gracias o serifas; lo que los anglosajones (proviniendo del francés) llaman sans serif, esto es, sin serifa. Las serifas (o gracias) son pequeños adornos ubicados generalmente en los extremos de las líneas de los caracteres tipográficos.

Con y sin serifa

Ambas tipografías (Helvética y Akzidenz Grotesk) eran asombrosamente iguales, aunque no al cien por cien. El principal cambio que realizó Max Miedinger en su Helvética fue la conocida como «altura de la x» (el alto que tiene una letra x minúscula y que establece la altura del ojo medio de todas las letras), haciéndola mayor que en la Akzidenz Grotesk, lo cual la hace parecer un poco más oblonga, mientras que la su antecesora mantiene su forma sutilmente aplastada.

Tipografía Helvética

Por su lado, Arial nace en 1982 de la mano de los diseñadores Robin Nicholas y Patricia Saunders, de la fundición americana Monotype, la competencia directa de Linotype y la única compañía que fue capaz de hacerle sombra a su rival en el mercado de la impresión. En un principio, la idea de Arial surge de la necesidad de responder a la alta popularidad de Helvética, y se desarrolló como fuente principal para las primeras impresoras láser de IBM.

En un principio llamada Sonoran San Serif, Arial tuvo la gracia de caer el manos de Microsoft, ya que la empresa de Redmond no estaba dispuesta a pagar lo que se pedía por Helvética. Cuando el tío Bill hizo de TrueType el formato estándar de fuente para Windows 3.1, se optó, pues, por utilizar Arial en lugar de Helvetica; sabían que la mayoría de la gente no notaría la diferencia ni se preocuparía por ella.

Apple, por otro lado, también hizo estándar el formato TrueType (lo habían desarrollado ellos para competir con el PostScript de Adobe) al mismo tiempo, pero ellos incluyeron Helvetica, y no Arial, como fuente principal, pagando religiosamente los derechos a Linotype.

En aquella época, el dominio de Windows sobre los sistemas de Apple fue aplastante, y ello popularizó de tal forma la fuente Arial que, hoy en día, es la más conocida del mundo. Microsoft siguió apostando fuerte por Arial como tipo base hasta Windows Vista, cuando fue sustituida por la fuente Calibri. Durante todos estos años, Arial ha sido la tipografía más popular sin ningún género de dudas.

Tipografía Arial

Sin embargo, Arial es considerada por los expertos tipógrafos como una copia burda y barata de Helvética, careciendo de las características que distinguieron al diseño original suizo. A pesar de ser casi idéntica a Helvetica en proporciones y peso, el diseño de Arial es una variación de la serie Grotesque de Monotype y fue concebida para ser usada en computadoras, más que para ser leída en papel. Este tipo de letra tiene cambios sutiles en la forma y el espacio entre caracteres con el fin de hacerla más apta para ser leída en una pantalla a distintas resoluciones de imagen.

Lo cierto es que la preeminencia de la Helvética de Linotype en el mercado hizo que Monotype se empeñara en diseñar un tipo de letra prácticamente igual. Sin embargo, y en lugar de fabricar una copia exacta como hicieron otros en la época, se encargó de añadir o quitar pequeños matices que hacían de Arial una fuente muy parecida pero diferente. Aunque, como veremos a continuación, las desemejanzas son tan sutiles, que los profesionales la consideran simplemente un calco de baja calidad gráfica.

Los chicos de ‘I Love Typography’ desarrollaron hace tiempo una simple pero estupenda herramienta a la que llamaron Fontometer (algo así como «fontómetro») y que colgaron en una de las entradas de su blog. Este Fontometer permite comparar los glifos de ambas tipografías haciendo uso de las distintas letras minúsculas del alfabeto inglés. Se encuentra a continuación y su forma de uso es muy sencilla. Únicamente debemos pasar el puntero de nuestro ratón por encima de los caracteres de la línea superior (en letra más grande los que más diferencias tienen a simple vista) para observar la comparación en la zona inferior (a la izquierda, en gris, Arial; a la derecha, en rojo, Helvética).

Una vez seleccionada la letra en cuestión, disponemos de la posibilidad de arrastrar el carácter Arial sobre el carácter Helvética. En este momento, cuando los superpongamos, nos percataremos de las verdaderas diferencias entre ambas fuentes. Nimias pero importantes diferencias (¡en todas las letras!).

La confrontación entre Arial y Helvética viene de viejo. El hecho de que Microsoft se decantara por Arial y Apple por Helvética avivó más las llamas del fuego cruzado. Los diseñadores y maquetadores expertos, muy inclinados hacia Mac OS desde siempre, hacen llagas sobre Arial y la tildan de estafa tipográfica. La verdad es que de Helvética se podría decir lo mismo con respecto a Akzidenz Grotesk. Es la historia de la humanidad y sus derechos de autor: basarse en algo y realizar un duplicado prácticamente exacto, ¿es copia y calco o es homenaje y veneración?

La controversia, por supuesto, ha alcanzado las lindes del friquismo más guasón. Desde ‘Ironic Sans’ nos proponen un divertido juego: han cogido 20 logotipos de famosas empresas diseñados originalmente con Helvética y los han reconstruido en Arial. ¿Sabrías distinguir el original de la imitación? También se puede realizar un test vía ‘I live on your visits’ en el que se propone diferenciar textos escritos en ambas fuentes.

Además, en ‘Mimeartist’ disponen de un juego en Flash en el que has de tomar la identidad de diversos caracteres en Helvética para derrotar y aplastar a letras Arial. Como última curiosidad, comentar que existe una película documental llamada ‘Helvética’ (2007) en la que diferentes diseñadores y tipógrafos hablan sobre este tipo, algunos alabándolo y otros atacándolo.

En fin, una pelea que, como otras tantas, nunca tendrá fin. A mí, personalmente, la verdad es que no me convence ninguna de las dos demasiado. Eso sí, antes que la maldición entre las maldiciones, me quedo con cualquiera de ellas del tirón. Faltaría más.

Cómo se hacían los videojuegos en los años ochenta

Listado BASIC de un Spectrum

La forma de trabajo de aquellos tiempos era bien distinta a lo que puede ocurrir en la actualidad. En un principio los videojuegos se diseñaban directamente sobre la máquina que los iba a ejecutar. Para ello existía una doble vertiente, en función de la calidad requerida y de los conocimientos del programador: desarrollar en ensamblador o desarrollar en algún lenguaje de alto nivel (comúnmente algún intérprete nativo de BASIC).

La diferencia entre ambas técnicas reside en la potencia del producto final. Evidentemente, programar en ensamblador ayuda a aprovechar al máximo las capacidades del aparato, ya que se hace necesario conocer a la perfección el funcionamiento interno del procesador y del resto del hardware, así como las instrucciones propietarias que presentan y permiten manejar. Hacerlo en un lenguaje de alto nivel acompaña en el proceso, debido a su sencillez de codificación con respecto al ensamblador, pero es muy posible que no exprima al cien por cien el funcionamiento de la máquina.

Para desarrollar un título que fuera compatible con las tres plataformas más conocidas al mismo tiempo, los programadores debían, pues, diseñar el juego para cada una de ellas particularmente, aprovechando muchas veces código en el traspaso debido a que las tres compartían el mismo procesador, un Z80. Sin embargo, el proceso resultaba tedioso y, para las empresas, poco rentable.

'Fernando Martín Basket Master' para Spectrum

Hacia el año 1987 apareció una herramienta denominada PDS (Programmers Development System), una suerte de sistema que hacía uso de un compilador cruzado y de un equipo de hardware para la época muy avanzado. Este equipo consistía en dos tarjetas, una ISA con dos puertos COM para un ordenador de 16 bit (que hacía las veces de equipo madre de programación) y otra que se insertaba en el equipo de 8 bit y que, en función de este, podía tener forma de cartucho o de periférico adaptado a él.

Desde el ordenador de 16 bit (bien un PC, un Amiga o un Atari) se diseñaba el juego para, después, enviarlo directamente, ya compilado y a través de un cable conectado a las tarjetas mencionadas, a la memoria de la máquina de 8 bit. De esta forma, el desarrollo era mucho más rápido y dinámico a causa de la potencia de los computadores de trabajo y, también, se disponía de la posibilidad de hacer cambios directamente sobre la memoria para comprobar el funcionamiento de los distintos elementos y de depurar errores prácticamente en tiempo de ejecución.

La pega de este sistema PDS es que él solito era capaz de generar las distintas compilaciones para las diferentes máquinas. Esto, que podría parecer una ventaja, sólo así lo era para los empresarios dueños de las producciones, pero no para el público final. El problema reside en que, a pesar de que los tres ordenadores compartan procesador principal, las capacidades gráficas, de audio, de memoria u otras no son las mismas. Por ejemplo, MSX tiene unas aptitudes gráficas bastante mejores que Spectrum, y Amstrad CPC un sistema de sonido también muy superior al de Spectrum.

Ello significaba que la primera versión que se desarrollaba era la de Spectrum para, posteriormente, convertirla, a través de mínimos cambios, para MSX y Amstrad. La inmensa mayoría de los juegos de la época eran conversiones directas de Spectrum, lo que cabreaba bastante a los usuarios de Amstrad o MSX, porque pagaban por juegos para sus plataformas que llevaban gráficos de Spectrum y el sonido chillón de los pitidos del beeper de Spectrum. En fin, no se aprovechaban las capacidades de las distintas máquinas, porque el objetivo era desarrollar rápido y vender mucho. Ojo, no siempre era así, pues algunas compañías como Opera Soft cuidaban muy mucho las versiones.

'Fernando Martín Basket Master' en Spectrum y Amstrad

Ricardo Cancho, a la sazón grafista de Topo Soft, en una entrevista que le hicieron el pasado año 2010 comenta algo que no tiene desperdicio:

Desde el punto de vista técnico, siempre empezábamos por la versión de Spectrum, pero con los cálculos de memoria realizados para el Amstrad. ¿Por qué? Muy sencillo: el Amstrad era el que más consumía en gráficos, literalmente el doble que en las otras máquinas, así que primero había que asegurarse de que el proyecto cupiese entero en esta plataforma. Una vez realizadas las estimaciones, ya podíamos ponernos a hacer gráficos, mapas, etcétera. Así que, paradójicamente, en las versiones de Spectrum siempre quedaba algo de memoria libre de sus 48 KB.

La versión de MSX se dejaba siempre para el final y solía ser un clon de la de Spectrum. El criterio era puramente económico: no se dedicaba ni un minuto de tiempo extra a esta plataforma, para así cumplir los plazos de entrega y de fecha de salida al mercado.

Una auténtica pena que la avaricia de los mercaderes aplastará ríos de imaginación y destreza informática por los siempre putos plazos de entrega. Pero hoy en día no es muy distinto. La única diferencia es que en aquellos tiempos, si realmente se aprovechaban las capacidades de cada equipo, el mismo juego para Sprectrum y MSX eran completamente polos opuestos. Hoy, si dejamos aparte la Wii de Nintendo por su clara inferioridad técnica, es lo mismo ser un poseedor de una PlayStation 3 o de un Xbox 360, porque los juegos se ven y se perciben de una forma exactamente igual en ambas plataformas. Y esto es algo que no tiene mucho sentido.

Ambas consolas actuales tienen unas capacidades similares, pero no iguales. Cabría pensar, además, que el hecho de que el soporte nativo de PlayStation 3 sea el Blu-ray Disc y el de Xbox 360 sea el DVD podría llevar aparejada una mayor cantidad de contenidos en los juegos de la consola de Sony (más niveles, más cortes de vídeo…), pero no es así. Los títulos para ambas consolas son prácticamente iguales, y las diferencias que se pueden encontrar son tan nimias que no merece la pena siquiera tenerlas en cuenta. Lo único que hoy día debería considerar un comprador a la hora de decidirse por una u otra, es el precio y, sobre todo, el catálogo de juegos.

'Dead Rising 2' en Xbox 360 y PS3

¿Qué es lo que impulsa esta tendencia? ¿Por qué se hacen juegos idénticos? ¿A qué oscuro acuerdo se ha llegado? Porque todo el mundo está de acuerdo en que, si se deseara realmente y se aprovecharan al máximo las capacidades de cada máquina, la guerra entre Sony y Microsoft podría ser brutal. Pero eso no ocurre, ni ocurrirá. La historia se repite, no sabemos si por motivos económicos, de mercado o de lo que fuere.

Para el que quiera profundizar más en este tema, desee disfrutar de un buen rato y tenga hora y cuarto que perder (o que ganar), os dejo con un podcast de RetroActivo, uno de los blog más interesantes, maduros, completos y profesionales del mundo retro de la informática y los videojuegos. En este vídeo ha tenido esta entrada su inspiración, pero os recomiendo el resto también sin ningún género de dudas.

Podcast #3 de RetroActivo

BTaprendiendo, la nueva red social de educación

BTaprendiendo

El universo social de las redes en Internet ha dado un vuelco enorme en los últimos tiempos. Los entornos de este tipo han pasado de ser meras salas de reunión para amigos en contacto a convertirse en auténticas herramientas de colaboración en línea. Ya sea en el entorno médico, en el del derecho o en el del deporte, las redes sociales han tomado las riendas de la comunicación dos punto cero, haciendo partícipes a sus miembros de un punto de encuentro sin parangón para el intercambio de ideas, noticias, modos de trabajo, clases maestras o cualquier tipo de información relevante.

BTaprendiendo parte de esa premisa e intenta poner en común a personas diversas con un mismo fondo: el mundo de la educación. Desde el alumno más joven hasta el pedagogo más experto tienen cabida en esta red. El objetivo es claro: proporcionar vínculos entre iguales para compartir información e interactuar de manera social.

En BTaprendiendo un alumno de Física podrá encontrar tutoriales que se adapten a sus querencias; un estudiante de Filología Inglesa tendrá la oportunidad de contactar con otros alumnos para practicar el idioma; un profesor de secundaria podrá disponer de un grupo de trabajo para mantenerse en contacto con sus alumnos; el padre de un niño con necesidades especiales dispondrá de herramientas para conversar mediante voz y vídeo con otro padre en la misma situación; una academia de informática podrá publicar sus cursos, horarios y tarifas. Las posibilidades son infinitas.

Esta red te permite, tras registrarte de manera gratuita, crear grupos de personas (públicos o privados) o unirte a los ya existentes, compartir archivos (tutoriales, apuntes, guías…) y vídeos (videotutoriales, presentaciones, demostraciones…), crear y participar de foros de noticias, realizar sesiones de chat y videoconferencia, generar salas de chat para conversaciones en grupo, escribir entradas de blog que podrás compartir, o no, con toda la comunidad, crear eventos para invitar a tus iguales, etcétera. Todo aquello que se te ocurra para interactuar lo tienes al alcance de un par de golpes de ratón.

Asimismo, BTaprendiendo te ofrece la posibilidad de buscar clases de apoyo, así como de anunciarte como profesor para impartir materias de manera particular. Todo ello, también, de forma totalmente gratuita, a través de una sección especial para este fin.

Además, La red irá creciendo conforme a las necesidades de sus miembros, y es más que posible que, en breve, aparezcan nuevas implementaciones de utilidades relacionadas con la educación. Un mundo de posibilidades que no te puedes perder.

Puedes ser miembro de BTaprendiendo y, al tiempo, seguir informado continuamente de las novedades y las noticias más importantes a través de otras vías anejas como son el blog de la red, su feed RSS, la página de Facebook o la cuenta en Twitter. El más amplio abanico para que no te quedes descolgado en ningún momento.

BTaprendiendo viene a revolucionar el panorama de las redes sociales, acercando a todos los integrantes del paisaje de la educación a un centro común y poniéndolos en contacto de una manera sencilla, intuitiva y potente. Regístrate ahora y comienza el viaje. No te lo puedes perder.

Por cierto, el tema está aún en fase Beta, por lo que es probable que encuentres cosas raras por ahí. Los problemas se irán solucionando poco a poco. Gracias por tu paciencia.

El aerógrafo prehistórico (o el efecto Venturi en el Paleolítico Superior)

Manos en negativo (Altamira)

Resulta curioso, cuando menos, comprobar cómo los descubrimientos científicos documentados y verificados tienen mucho de documentados, mucho de verificados pero poco de descubrimientos. La física de los instrumentos modernos, la química de los seres vivos o la mecánica de los aparatos actuales siempre estuvieron ahí, esperando a que alguien los repitiera artificialmente y los plasmará en un papel, asignando su nombre al hallazgo para la posteridad. Pero ello no quiere decir que antes no hubiera habido otro que, por casualidad, descubriera lo mismo y lo utilizara profusamente, sin haber estampado su firma en un legajo junto a su fortuito encuentro; muchas veces porque ni siquiera, en ese momento, se había inventado el papel.

Es el caso, entre otros muchos, del aerógrafo prehistórico. Si uno se da una vuelta por la cueva de Ardales (Málaga), por la de Maltravieso (Cáceres), por la cueva de Altamira (Cantabria) o por la de Tito Bustillo (Asturias), podrá comprobar como en las propias cavidades horadadas en la roca (si es que son visitables) o en los museos cercanos, se le muestra uno de los descubrimientos arqueológicos más curiosos y que más trajo de cabeza a los expertos durante años: las pinturas de manos en negativo.

Mano en negativo (Pech Merle, Francia)

Estos dibujos, como se puede comprobar en la imagen anterior, son representaciones de manos de los antiguos habitantes paleolíticos de las cuevas. Sin embargo, y como cabría esperar, la pintura no ha sido plasmada cubriendo la palma de tinte y estampándola contra la pared, puesto que lo pintado aparece alrededor de la figura de la mano, dejando el hueco ocupado por ésta sin teñir. De ahí su denominación de «manos en negativo».

El descubrimiento hizo pensar mucho a los arqueólogos de hace décadas. Lo primero que se investigó fue el pintado periférico, es decir, se supuso que el autor habría colocado la mano en la roca y, con un dedo de la otra mano impregnado en una tintura, habría ido coloreando la periferia. La hipótesis se desechó enseguida, porque las pruebas que se llevaron a cabo no producían manos como aquellas. Las originales parecían haber sido creadas no a base de pinceladas, sino por la expulsión violenta de pintura sobre la mano, dejando esa mancha característica alrededor.

La segunda hipótesis hizo a los expertos realizar la prueba por medio del soplado de tinte sobre la mano en la pared, lo que se conoce como técnica del estarcido. Una delgada pajita, que podría ser un pequeño hueso perforado, hacía las veces de conducto por el que escupir la pintura a presión desde la boca del artista. Sin embargo, aquella prueba tampoco resulto nada concluyente. La mancha de colorante se formaba por gotas de variado tamaño, inconexas entre sí y de aspecto tosco y burdo. No era una imagen tan homogénea como la de las manos de los hombres prehistóricos, representadas por diminutas partículas de pintura como si se hubiera producido una pulverización con nuestros aerosoles actuales. ¿Cómo es posible que aquella gente utilizara alguna técnica que hoy en día no somos capaces de reproducir?, se preguntaban los arqueólogos.

Una tercera vertiente defendía un procedimiento que emplearía un pincel o brocha, fabricado con pelo de caballo, agitado enérgicamente, salpicando la pared y dejando el hueco de la mano limpio. Los resultados tampoco fueron los esperados.

Al fin, y gracias a varios hallazgos cercanos a las pinturas en los que aparecían los instrumentos utilizados (un cuenco y dos pequeños huesecillos de ave huecos), la incógnita pudo ser despejada. Los hombres paleolíticos habían descubierto el denominado efecto Venturi algunas decenas de miles de años antes de que el reconocido físico italiano le pusiera su nombre.

Como diría nuestra amiga la Wikipedia, el efecto Venturi se explica por el principio de Bernoulli y el principio de continuidad de masa. Si el caudal de un fluido es constante pero la sección disminuye, necesariamente la velocidad aumenta tras atravesar esta sección. Por el teorema de la conservación de la energía mecánica, si la energía cinética aumenta, la energía determinada por el valor de la presión disminuye forzosamente.

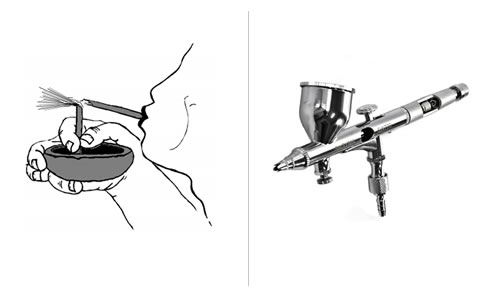

Este efecto es fácilmente reproducible con instrumentos básicos: un par de pajitas pequeñas y un cuenco con algún pigmento desleído en agua. Uno de los tubitos ha de tener un extremo sumergido en el líquido, el otro se coloca perpendicular al anterior y junto a él, quedando los centros de los orificios, pues, perpendiculares y separados por un milímetro o menos. Se sopla enérgicamente y se produce la pulverización. Es exactamente la misma técnica de la que se sirven los aerógrafos actuales.

El antes y el ahora de la aerografía

Físicamente, al soplar con fuerza por el tubo horizontal, la velocidad del aire hace que la presión disminuya en el extremo superior del tubo vertical. La diferencia de presiones resultante en ambos extremos de este tubo produce que la columna de tinte ascienda, empujada por la presión atmosférica. Cuando la pintura sube, se encuentra con el chorro de aire y se produce la salida pulverizada de la misma.

Las primeras manos en negativo conocidas se representaron en las cuevas de Cosquer (Marsella) y Gargas (Pirineos de Ariége) hace aproximadamente 27.000 años. Los principales conjuntos de este tipo de pintura prehistórica en la Península Ibérica se realizaron en fechas posteriores, coincidiendo con el Magdaleniense. Si bien es cierto que el foco más importante de manos en negativo se desarrolló en la región franco-cantábrica, existen importantes ejemplos en la Patagonia, Italia, Austria, Borneo, Norte de África, Urales o la India.

Aquellos antiguos habitantes de nuestro mundo nunca supieron lo importante que el efecto Venturi llegaría a ser para nuestras vidas actuales (carburadores de automóviles, pistolas de pintura, duchas de alta eficiencia, dispositivos antifugas para lavadoras, etcétera), pero tampoco supieron discernir la física del invento. Simplemente soplaban y utilizaban una tecnología que, probablemente, descubrieran por casualidad [modo 'Iker Jiménez' ON] les fuera entregada por seres inteligentes provenientes de otras dimensiones [modo 'Iker Jiménez' OFF].

Os dejo con un vídeo demostrativo en el que unas jovenzuelas colegiales explican perfectamente, y de una forma práctica, todo lo anteriormente comentado. Eso sí, con mucho guión y muy poquita naturalidad escénica, la verdad. Pero sirve.

Demostración del aerógrafo prehistórico