Entradas de la categoría ‘Cacharros antiguos’

El USB no es simétrico por culpa de un error humano

Durante décadas hemos convivido con un pequeño drama tecnológico que todos compartimos en silencio, el de intentar conectar un USB (de los del tipo A) a la primera. Esa operación cotidiana, en apariencia inocente, se convirtió en una especie de ritual universal compuesto por tres pasos invariables. Primero lo intentas poner; no entra. Le das la vuelta; tampoco entra. Vuelves a ponerlo como al principio y, entonces, ¡SÍ!. La humanidad ha aceptado este fenómeno como algo natural, como si la física se pusiera juguetona sólo cuando se trata de un puerto USB.

Pero detrás de esta tragicomedia electrónica no hay magia, ni mala suerte, ni un complot internacional para vernos sufrir. La explicación es mucho más simple y más humana: alguien tomó una mala decisión. La asimetría del USB tradicional no responde a una razón técnica superior, ni a un avance de ingeniería, ni a una propiedad exótica. Se debe a un error de cálculo, a un «esto no va a dar problemas, seguro» que resultó ser menos profético que las predicciones del tiempo del siglo pasado.

Para entenderlo hay que viajar mentalmente a mediados de los años noventa, una era en la que los ordenadores parecían naves industriales con patas. El hardware estaba plagado de conectores gigantescos, lentos y extravagantes, y había puertos paralelo, serie, PS/2, SCSI y un montón de cables que daban miedo sólo con verlos. En ese caos nació el concepto de USB como un conector pequeño y universal que prometía terminar para siempre con aquel zoológico de interfaces incompatibles. El proyecto estaba liderado por Ajay Bhatt, ingeniero de Intel, que se propuso crear un estándar barato, fácil de usar y prácticamente indestructible.

El diseño inicial funcionó. El USB era pequeño, económico y soportaba futuras evoluciones, pero lo que no era, en absoluto, es un conector reversible. En aquel momento, la prioridad no era la ergonomía del usuario, ni la estética, ni la experiencia de enchufar algo sin pensar. La obsesión era reducir costes. Y aquí está el detalle que marcó a toda una generación. Y es que hacer el USB reversible requería duplicar los contactos internos del conector, lo que habría incrementado el precio del componente prácticamente al doble. En una época donde cada centavo de dólar contaba y donde el objetivo era fabricar cientos de millones de unidades, la idea quedó descartada por innecesaria.

Lo irónico es que los ingenieros sí valoraron la opción de un diseño reversible. No fue una idea descartada por imposibilidad técnica, sino por economía y, sobre todo, por falta de visión a largo plazo. Se asumió que la gente no tendría problemas en conectar el USB con la orientación correcta, que nadie se confundiría, que sería fácil. Y ya sabemos cómo terminó eso. El coste del error no se midió en dólares, sino en frustración global repetida miles de veces al día a lo ancho del globo.

Años más tarde, Ajay Bhatt reconoció públicamente que habría sido mejor hacerlo reversible desde el principio; lo dijo sin rodeos. Pero también habría sido más caro, y en 1996 la industria no estaba dispuesta a pagar esa diferencia. La decisión estaba tomada, y el destino del USB quedaba sellado, pasando a la historia como uno de los conectores más útiles jamás creados y, al mismo tiempo, como uno de los más irritantes.

No sería hasta dos décadas después cuando alguien volvió a plantear seriamente la necesidad de un conector verdaderamente universal. De ese replanteamiento nació el USB‑C, un estándar que no sólo es reversible, sino que también sirve para carga de dispositivos, trasferencia de datos, transmisión vídeo, alimentación de monitores, transporte de audio y casi cualquier cosa que se pueda transferir por un cable sin ofender las leyes de la electrónica. El USB‑C es, básicamente, lo que el USB siempre quiso ser pero no pudo ser por culpa de un recorte presupuestario noventero.

Lo divertido de todo esto es que la tecnología actual nos demuestra que aquello que era «demasiado caro» hace veinte años hoy resulta indispensable. El USB‑C se ha convertido en el estándar moderno precisamente porque soluciona el mayor defecto del de tipo A: su incomprensible orgullo por tener una sola forma válida de entrar.

Al final, la moraleja es sencilla y un poco reconfortante. La próxima vez que falles en algo simple o estúpido —como dejar las llaves dentro del coche o enviar un correo importante al destinatario equivocado— recuerda que incluso ingenieros brillantes arrastraron al mundo entero durante décadas por una decisión aparentemente insignificante. El USB no es simétrico porque alguien se equivocó o no quiso aportar más dinero al proyecto. Y gracias a ello, ahora tenemos un conector moderno que parece mágico en comparación con aquel. A veces, de los errores también se alumbra progreso. Aunque tardemos veinte años en arreglarlo.

El bus VLB: cuando decidieron ponerle un cohete a la placa base y salió regular

El VESA Local Bus, más conocido como VLB, fue uno de esos inventos que solo pudieron nacer en los turbulentos años noventa, cuando la industria del PC estaba creciendo a un ritmo demasiado rápido como para esperar a que Intel lo resolviera todo con elegancia.

A principios de aquella década, la transición del 386 al 486 había disparado la capacidad de cálculo del procesador, pero el resto del sistema, especialmente el venerable bus ISA, seguía arrastrándose con sus 16 bits a 8 MHz y un ancho de banda que hoy haría sonrojar a un reloj digital de los chinos. El resultado era un cuello de botella monumental, sobre todo en un área que empezaba a adquirir importancia crítica: el vídeo. Los modos SVGA, las resoluciones superiores a 640×480 y el incremento del consumo gráfico exigían un canal más rápido entre el procesador y las tarjetas de expansión. El ISA no daba más de sí, y el EISA, aunque mejorado, era caro y orientado a servidores. La industria doméstica necesitaba una solución inmediata, barata y lo suficientemente potente para aguantar hasta que apareciera un estándar más serio.

Ahí entró en juego la Video Electronics Standards Association (VESA), una agrupación de fabricantes preocupados por la interoperabilidad de los estándares gráficos. En 1992 propusieron una solución atrevida y claramente transitoria: un bus que literalmente colgase del bus local del procesador 486, aprovechando sus líneas de datos de 32 bits y su frecuencia de reloj, normalmente entre 25 y 50 MHz. El resultado fue el VLB, un bus con un rendimiento teórico de más de 100 MB/s, lo cual rondaba entre diez y quince veces la capacidad del humilde ISA. La idea era tan simple como peligrosa, pues si el problema se concentraba en que el bus ISA era lento, ¿por qué no permitíamos a la tarjeta gráfica acceder directamente al bus del procesador? Era como dejar a un mecánico enchufar un turbo al motor sin avisar al fabricante del coche. Pero la necesidad era urgente, y el truco funcionó.

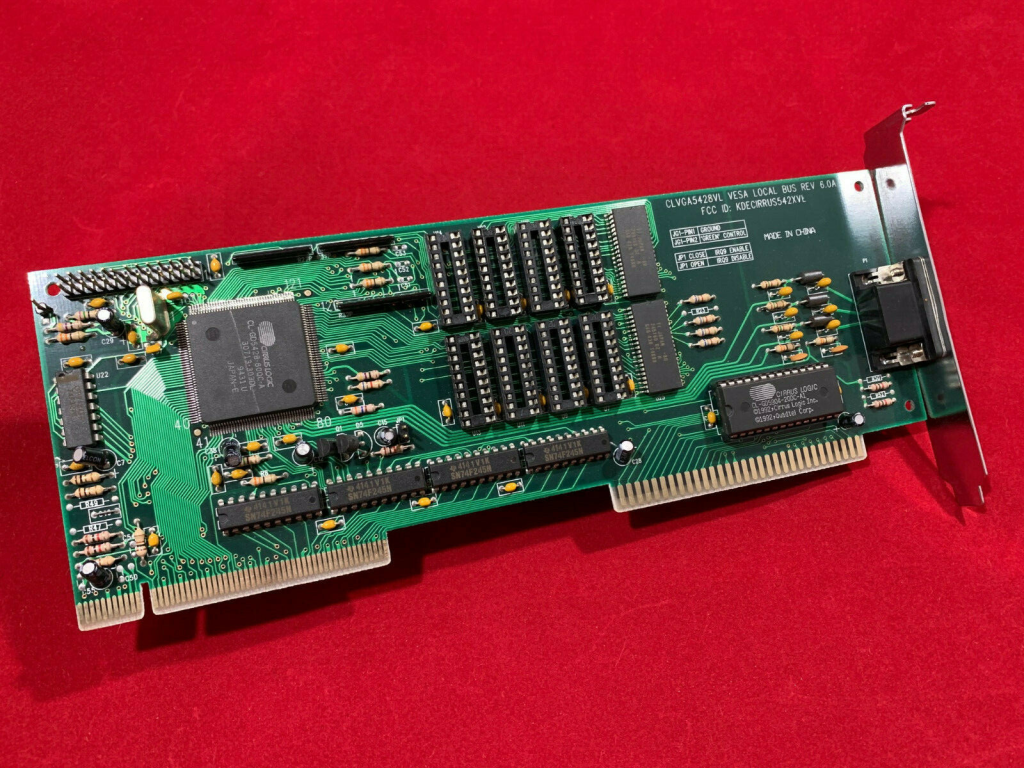

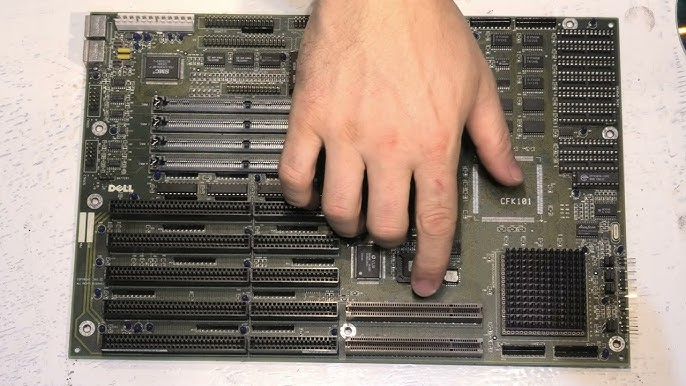

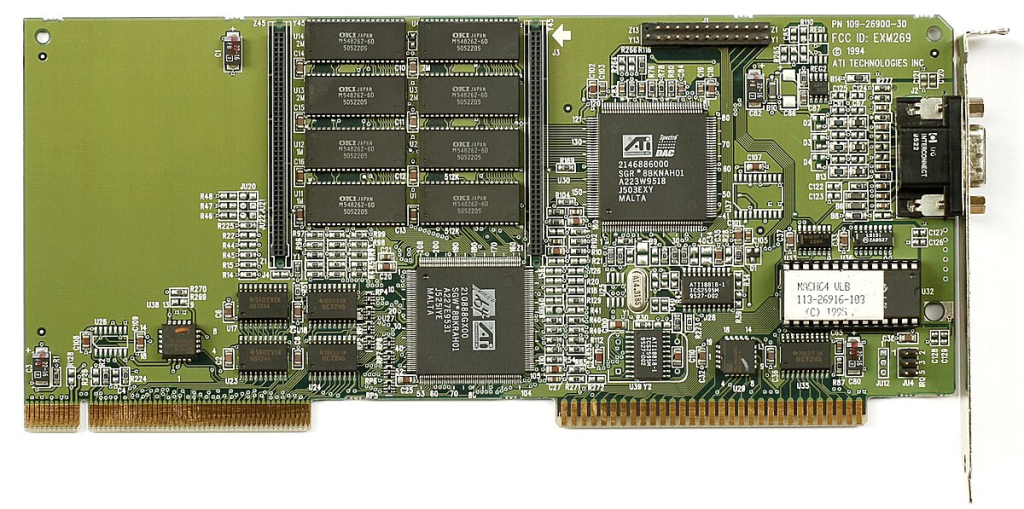

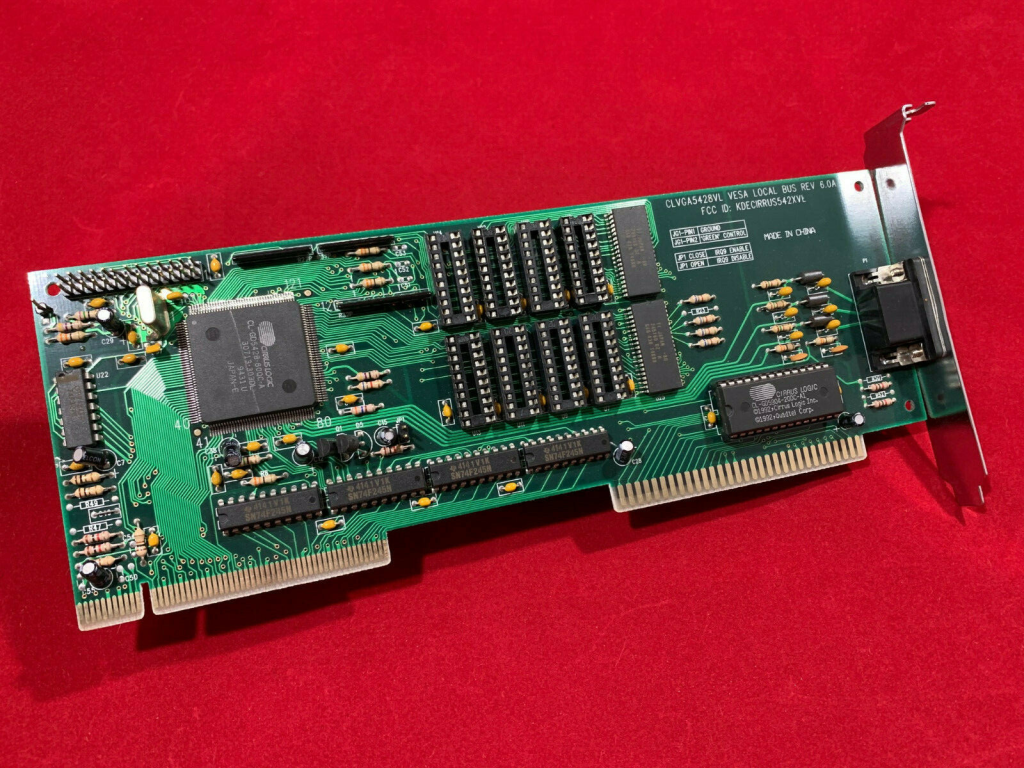

Físicamente, el VLB consistía en un conector adicional situado a continuación de la ranura ISA estándar. Por eso las tarjetas VLB eran tan largas, porque una parte ocupaba la ranura ISA tradicional y otra encajaba en la extensión VLB, como si hubieran injertado dos tarjetas en una. Esa longitud extrema no era un capricho, sino consecuencia del número de señales adicionales que el bus necesitaba para sincronizarse con el microprocesador. Y aquí empezaban los problemas, pues al depender directamente del reloj del CPU, cualquier variación en la placa base, cualquier imprecisión en las pistas o cualquier exceso de longitud podía provocar inestabilidad.

Las placas base tenían que diseñarse como si fueran instrumentos de precisión, porque las señales de VLB no toleraban retardos significativos. Los fabricantes solían anunciar compatibilidad con 40 MHz, pero muchos equipos se desplomaban al intentar usar el bus por encima de 33 MHz. Además, aunque el estándar permitía hasta tres ranuras VLB por placa madre, pocas se atrevían a implementar más de una y, cuando incluían dos, hacerlo funcionar todo a la vez y sin errores era casi un acto de magia.

El propósito principal del VLB fue acelerar las tarjetas gráficas. En 1992 y 1993, cuando los chips de Cirrus Logic, S3, Tseng Labs o Trident dominaban el mercado SVGA, disponer de un bus rápido podía marcar una diferencia sustancial en operaciones de transferencia de vídeo, escritura en framebuffer y uso de aceleración 2D primitiva.

Pero las gráficas no fueron las únicas beneficiadas. Muy pronto comenzaron a aparecer controladoras IDE y SCSI con interfaz VLB, aprovechando el mayor ancho de banda para transferencias de disco. También surgieron tarjetas de red y adaptadores multi-I/O que, sobre el papel, prometían un rendimiento superior al de sus equivalentes ISA. La realidad era más ambivalente, ya que no todas estas tarjetas lograban beneficios tangibles, pero cuando lo hacían, el salto era apreciable. Para un PC doméstico de mediados de los noventa que dependía del 486, el VLB era, sin exagerar, la única vía práctica para obtener un rendimiento gráfico competitivo.

El motivo de su caída fue, precisamente, su propia naturaleza improvisada. El VLB estaba diseñado alrededor del 486 y no tenía futuro más allá de él. Pentium introdujo cambios sustanciales en el bus del procesador y exigía una arquitectura completamente distinta para la comunicación con dispositivos de expansión. Intel llevaba años desarrollando un estándar más sofisticado, independiente del reloj del procesador, más estable, más escalable y más apto para un ecosistema en expansión: el bus PCI, que comenzó a imponerse hacia 1994 y se convirtió en el estándar dominante apenas un año después. Frente al PCI, el VLB parecía lo que realmente era: un puente improvisado. No soportaba bien mayores frecuencias, no era compatible con arquitecturas posteriores, carecía de mecanismos avanzados de arbitraje y su dependencia directa del procesador imponía restricciones insostenibles. Cuando las placas base para Pentium empezaron a llegar en masa, prácticamente todas eliminaron el VLB y adoptaron PCI de forma contundente.

Podría parecer que el VLB fue un fracaso, pero sería injusto. Cumplió exactamente la función para la que fue creado: ofrecer una interfaz de alta velocidad en los meses en los que no existía otra alternativa viable. Permitió que los 486 exprimieran todo su rendimiento gráfico justo cuando más se necesitaba, mantuvo viva la competitividad de los PC compatibles frente a estaciones propietarias y, de paso, evitó que el ISA siguiera lastrando al mercado un par de años más. Fue un invento efímero pero crucial, una pieza de ingeniería pragmática que resolvió un problema urgente a pesar de ser frágil, caprichosa y tremendamente sensible a las particularidades del hardware.

Hoy, ver una tarjeta VLB es casi un ritual arqueológico: largas, pesadas, con el conector doble característico; recuerdan una época en la que la informática de consumo avanzaba tan deprisa que los estándares nacían con fecha de caducidad incorporada. El VLB no sobrevivió a su tiempo, pero dejó una huella decisiva en la transición tecnológica de los primeros noventa. Fue un puente, sí, pero un puente que sostuvo todo el peso del mercado mientras la industria corría a construir algo mejor.

Sound Blaster: la tarjeta de sonido que puso música a nuestra infancia digital

Hubo un tiempo en que los ordenadores eran mudos, silenciosos, como si estuvieran enfadados con el mundo o no tuvieran nada interesante que decir. A lo sumo, un triste bip monofónico salía del altavoz interno al encenderlos, como un bostezo electrónico. Y gracias, porque para muchos juegos de la época ese altavoz de la placa era el único intérprete disponible: chasquidos metálicos, pitidos que simulaban disparos y melodías reducidas al rango más pobre.

En aquella era prehistórica del audio digital, algunos pioneros se atrevieron a meter tarjetas de sonido en los PC. Una de las primeras fue la AdLib, canadiense ella, que usaba un chip Yamaha OPL2 para ofrecer síntesis FM. Sintetizar música, sí, pero con matices. Aquella tarjeta fue como pasar del ruido de una impresora matricial a una cinta de casete de los 40 Principales. Pero la AdLib, por rompedora que fuera, tenía una limitación importante: sólo podía generar sonidos, no reproducir muestras digitales. No podías escuchar una voz grabada, ni un disparo realista, ni el grito de un personaje pixelado, por ejemplo. Y entonces llegó Creative Labs, desde Singapur, y lo cambió todo.

La primera Sound Blaster apareció en 1989 y era, literalmente, una AdLib vitaminada. Compatible 100 % con los estándares de moda, pero además con capacidad para reproducir audio digitalizado, algo que en aquel momento sonaba (nunca mejor dicho) a ciencia ficción. Y como guinda, incluía un puerto de joystick integrado, lo que hacía que los adolescentes ya no tuvieran excusa para no jugar a Wing Commander como se debía.

Aquel movimiento fue brillante: Creative no sólo sacó una tarjeta mejor, sino que la hizo compatible con lo que ya existía, facilitando su adopción por desarrolladores y usuarios. En muy poco tiempo, Sound Blaster se convirtió en el estándar de facto del sonido para PC. Si un juego era serio, tenía que soportarla. Y si no la tenías, te sentías medio cojo.

Los años noventa fueron el reinado absoluto de la familia Sound Blaster. La Pro, la 16, la AWE32, la AWE64…, cada una mejoraba a la anterior con más canales, más calidad, más memoria para soundfonts, en general, más cacharrería para que los juegos sonaran a gloria. Aquellos que recuerden el salto de un Commander Keen en speaker a un Doom con música MIDI y efectos PCM sabrán de lo que hablamos. Era como pasar de una maqueta a una película de verdad.

Eso sí, instalar una de estas tarjetas no era tarea para cobardes. Había que lidiar con puertos I/O, canales DMA, las IRQ que se peleaban con la controladora IDE o con el módem de 14,4 kbps. Te pasabas más tiempo configurando el autoexec.bat y el config.sys que jugando. Pero cuando lo conseguías… Escuchar la voz digitalizada de Guybrush Threepwood en Monkey Island o el rugido de una ametralladora en Duke Nukem 3D valía cada minuto perdido.

El impacto fue tal que, hasta en la demoscene, la Sound Blaster se convirtió en pieza clave. Los ficheros MOD, la música tracker, las demos de 64K que metían tecno ochentero con sincronización visual…, todo se apoyaba en esa tarjeta, en esa capacidad de reproducir samples a distintos tonos, en ese chip que parecía sacado de una radio pirata del futuro.

Pero todo reinado llega a su fin. Con la llegada de Windows 95 y DirectSound, muchas cosas cambiaron. El sistema operativo empezó a abstraer el hardware, los fabricantes de placas base comenzaron a integrar audio suficientemente bueno y la necesidad de comprarse una tarjeta dedicada fue desvaneciéndose. Creative resistió durante años con las gamas Audigy y X-Fi, incluso flirteando con los jugadores hardcore con latencias bajas y efectos envolventes, pero el mercado ya no era el mismo.

Hoy en día, las Sound Blaster viven en el recuerdo, en los foros de retrohardware, en los emuladores como DOSBox y en los corazoncitos de quienes alguna vez escuchamos por primera vez una voz digitalizada en un PC y dijimos «¡esto habla!». Algunos entusiastas aún las usan para revivir máquinas antiguas y jugar como en los viejos tiempos, con drivers que hay que buscar en disquetes, en páginas abandonware, o en archivos ZIP con nombres como sb16drv.zip.

La Sound Blaster no fue sólo una tarjeta de sonido, fue la primera vez que un PC tuvo alma, que dejó de ser un robot mudo y se convirtió en una máquina capaz de emocionar. Nos enseñó que los bits también pueden cantar. Y eso, para quienes lo vivimos, es un algo que ya no se olvida.

La tragaperras española Mini Super Fruits

La compañía española de juego y ocio CIRSA se funda en Terrassa (provincia de Barcelona) en el año 1978, de la mano Manuel Lao Hernández, como un pequeño laboratorio con la denominación Compañía Internacional de Recreativos, S. A. —nombre que cambiaría al actual en 1983—, para administrar un negocio de máquinas tipo B (comúnmente conocidas en España como tragaperras).

Sólo un año después, en 1979, la empresa empieza a diseñar y fabricar máquinas de esta clase para el sector de la hostelería en el mercado español, convirtiéndose en poco tiempo en líder nacional, tanto en fabricación como en el área operacional.

En 1981 sale al mercado Mini Super Fruits, una de las tragaperras de sobremesa más famosas y recordadas de CIRSA, ocupando bares y lugares de ocio con su característico diseño de luces y frutas y su recordado soniquete de «If I Were a Rich Man» (del musical de 1964, ‘El violinista en el tejado’) al sacar el premio gordo o especial con las tres manzanas del logotipo de CIRSA.

El microprocesador que montaba era un Intel 8085, muy usado en las maquinas arcade y tragaperras de la epoca. El software residía en tres memorias EPROM 2716 (SMCI2716) de 16 kilobits que, junto con una memoria PROM bipolar usada como decodificador de direcciones y una memoria 256×4 CMOS RAM, constituían el cerebro de la máquina. Del sonido, por su lado, se encargaba el chip PSG AY-3-8910 de tres voces fabricado por General Instrument.

La tragaperras, en lugar de montar los rodillos clásicos, lucía unos visores con lámparas que hacían de la máquina más atractiva, vistosa y moderna para la época. Disponía de dos monederos mecánicos, uno para 5 pesetas y otro para 25 pesetas. El premio gordo era de 500 pesetas (cuando salían los tres logos de CIRSA). El plan de ganancias, en lugar de reflejar la cantidad de dinero correspondiente a cada premio, indicaba el número de monedas de 5 pesetas que pagaba.

La CPU y la placa base se encontraban ubicadas en la puerta trasera. En la parte delantera estaba la marquesina con el plan de ganancias, una fluorescente de 6 vatios para la bandeja del hopper (monedero) y la placa de los visores.

La tecnología usada por CIRSA para los visores de esta máquina, y de algunas otras fabricadas posteriormente (como CIRSA Mini Guay), consistía en unas laminas de plástico transparente con minúsculas muescas formando el dibujo de la fruta. Los cantos de las láminas estaban coloreados de forma que, al ser iluminados con una lámpara de 12 voltios, creaban el efecto puntos de luz, como si fuesen generados por luces led modernas o similares.

Cada figura estaba iluminada por dos lámparas (una para la zona izquierda y otra para la derecha). Unas láminas se alumbraban desde la parte superior y otras desde la parte inferior, por lo que cada visor contenía 14 lámparas para iluminar las 7 figuras.

Mini Super Fruits estaba montada sobre una peana de madera, aunque se podía colocar encima de un mostrador o de una barra de bar. Seguramente, muchos de nosotros así la vimos por primera vez, ya que era uno de los reclamos más novedosos en los lugares de ocio de principios de los ochenta del siglo pasado.

Un invento adelantado a su época: el teatrófono

En el París del siglo XIX, las damas y los caballeros de poder adquisitivo elevado vestían sus mejores galas para acudir a fastuosas representaciones de teatro e imponentes óperas de orondas sopranos. Ellos con pantalones de trabillas, ajustadas levitas, zapatos de charol, chistera y bastón; ellas con blusas de cuello alto con encajes, corsés, amplias faldas de vuelo holgado con faralaes, botines de tacón y tocado o sombrero. La más alta representación de la más alta sociedad pudiente.

Sin embargo, los menos adinerados, aquella gente de estofas más bajas, no disponían de posibles para poder acudir a estos actos sociales. Aquello trajo de cabeza durante muchos años al ingeniero francés Clément Ader, que no podía entender por qué la cultura sólo podía estar al alcance de unos pocos, y no de todo el pueblo. Este hombre habría sido el perfecto pirata en el siglo de las comunicaciones 2.0.

Preocupado por la instrucción de sus contemporáneos, en 1881 presentó en París un sistema al que bautizó como teatrófono (théâtrophone en francés). Consistía en una serie de procedimientos tecnológicos del momento que permitían escuchar una ópera o una obra teatral cómodamente sentado en casa, a través de las líneas telefónicas y en tiempo real. La presentación fue todo un éxito.

Ader colocó frente al escenario 80 transmisores telefónicos, creando así una forma de sonido estereofónico binaural u holofónico, esto es, sonidos diseñados para generar sensación de tridimensionalidad en el cerebro, haciendo creer a los escuchadores estar inmersos en el propio ambiente del recinto teatral. Los transmisores enviaban la señal a una estación secundaria instalada en el propio teatro y, desde allí, se remitía a un gigantesco concentrador que se asemejaba a una centralita telefónica de las de entonces, donde señoritas sentadas frente a paneles conectaban y desconectaban clavijas como locas.

Ader colocó frente al escenario 80 transmisores telefónicos, creando así una forma de sonido estereofónico binaural u holofónico, esto es, sonidos diseñados para generar sensación de tridimensionalidad en el cerebro, haciendo creer a los escuchadores estar inmersos en el propio ambiente del recinto teatral. Los transmisores enviaban la señal a una estación secundaria instalada en el propio teatro y, desde allí, se remitía a un gigantesco concentrador que se asemejaba a una centralita telefónica de las de entonces, donde señoritas sentadas frente a paneles conectaban y desconectaban clavijas como locas.